요즘 가장 뜨거운🔥, 그리고 자주 언급되는 메타버스에 대해 살펴보고자 한다.

메타버스 및 메타버스 플랫폼에 대한 개념을 정리하고, 메타버스 플랫폼을 오픈하기 위해 어떤 기술 요소들이 필요한지 알아본다.

📑 한눈에 보기

- 메타버스 구성 요소

- 메타버스 구현을 위한 엔진

- 메타버스 구현 환경

- 알서포트의 메타버스

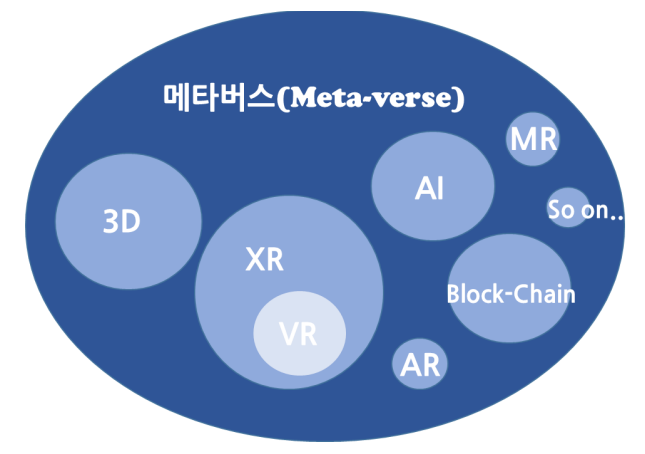

메타버스(Metaverse)는 가공, 추상을 의미하는 그리스어 ‘메타(meta)’와 경험 세계, 현실 세계를 의미하는 ‘유니버스(universe)’의 합성어이다. 현실과 가상의 경계가 사라진 세상을 의미하는 단어의 결합 그대로 가상의 세계를 마치 현실의 세계처럼 살아가는 것이라고 이해하면 된다. 개인과 기업이 함께 콘텐츠를 생산하며 자유롭게 놀 수 있고, 소비할 수 있는 경제 구조를 가졌기에 메타버스를 좀 더 넓은 경제 구조, 일종의 생태계라고 표현할 수 있겠다. 메타버스를 구현하는데 여러 기술적 요소가 필요하다. 대표적으로 3D, 확장현실(XR), 인공지능(AI), 블록체인 (BlockChain) 등이 있다.

확장현실(XR)의 정의

확장현실(eXtended Reality, XR)은 가상현실(Virtual Reality, VR)과 증강현실(Augmented Reality, AR)을 아우르는 혼합현실(Mixed Reality, MR) 기술을 망라하는 용어다. 가상 현실(VR)이 360 도 영상을 바탕으로 새로운 현실을 경험하도록 하는 기술이라, 증강현실(AR)은 실제 사물 위에 컴퓨터그래픽(CG)을 통해 정보와 콘텐츠를 표시한다. 확장현실(XR)은 가상 현실 · 증강현실 기술의 개별 활용, 또는 혼합 활용을 자유롭게 선택하며 확장된 현실을 창조한다. 사용자 입장에서 간단히 설명하면 가상현실(VR)은 사용자의 눈 전체를 덮어 착용하는 헤드셋형(Head mounted Display, HMD) 단말기를 필요로 하고, 증강현실(AR)은 구글 글래스와 같은 안경으로

표현이 가능하다. 확장현실(XR)은 홀로렌즈가 탑재된 안경 형태의 기기가 필요하며, 해당 기기로 현실 공간과 사물 정보를 파악하여 최적화된 3D 홀로그램 표시 값을 확인할 수 있다. 이 문서에서 설명하고자 하는 기술은 3D 와 XR 이다. 그 중에서도 VR 에 초점을 둔다.

3D 정의와 구현 방법

우선 3D(Three Dimensional)에 대해서 살펴보자. 한 가지 짚고 넘어가야 할 부분은 바로 3D 와 3D 입체 기술의 차이다. ‘3D 입체 기술’은 근본적으로 3D 와 그 개념을 달리한다. 3D(Three Dimension)는 면과 면으로 이루어져 있는 차원이다. 우리가 사는 공간은 3 차원이며, 물리학에서는 시간을 포함하여 시공간으로 나타낸다. 반면, 3D 입체 기술은 3 차원상의 공간을 의미하는 것이 아니라 단순히 입체감에만 그 중점을 두고 있기 때문에 실제 3차원상의 좌표나 공간 개념을 활용하지 않고 단순히 양안에 서로 다른 이미지를 주사하는 데 그 기본을 두고 있다. 이 문서에서는 3D 입체 기술이 아닌 3D, 그 중에서도 ‘3D 그래픽’ 기술 구현에 대해 서술한다.

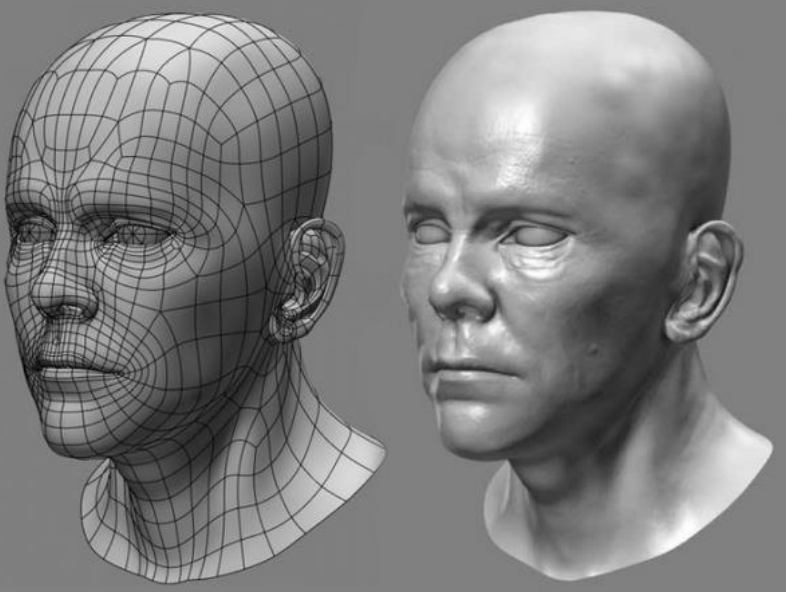

3D 그래픽 기술은 컴퓨터에 저장된 모델 내 각 점의 위치를 높이, 폭, 깊이의 3 축으로 하는 공간 좌표로 저장하는 기하학적 데이터를 이용해 3 차원적으로 표현한 뒤 다시 2 차원적 결과물로 처리 · 출력하는 기술을 말한다. 우리는 일상에서도 많은 디지털 콘텐츠를 3D 로 접할 수 있다. 그만큼 3D 개발 환경이 많이 좋아졌다는 방증이다. 3D 기술은 DirectX , OpenGL 등 게임 쪽에서 가장 많은 발전을 이뤘다. 요즘에는 타 분야에서도 쉽게 3D 가 적용된 콘텐츠를 쉽게 접할 수 있다. 3D 지형이나 3D 로 표현된 사람과 같은 캐릭터도 마찬가지다.

기술적으로 간단하게 설명하면, 3D 그래픽을 구현하는 방법은 카메라에 비치는 시각화된 정보를 그려주는 것과 유사하다. 방송국에서 방송 카메라로 촬영된 영상이 우리가 시청하는 TV 나 스마트폰 등의 화면으로 보이게 되는 것과 비슷하다고 생각하면 이해가 될 것이다. 다른 점이 있다면 카메라로 촬영된 영상은 실제 세상에 존재하는 물체를 촬영한 것이고 프로그램으로 개발한 가상의 3D 세계는 디지털 데이터로 모든 것을 표현한다는 점이다.

가상의 3D 물체를 표현할 때 가장 기본이 되는 요소는 ‘버텍스(Vertex)’ 라고 하는 ‘점’ 이다. 물론, 이 버텍스 라고 하는 ‘점’ 하나를 가지고 무엇인가를 표현하기는 불가능하다. 이 점을 연결해서 만들어내는 삼각형 및 사각형 형태의 모양을 ‘폴리곤(Polygon)’이라고 부른다. 폴리곤의 개수가 많을수록 부드럽고 정교한 물체를 표현할 수 있다. 폴리곤으로 물체의 형태를 표현할 수는 있지만 질감이나 색상을 표현할 수는 없다. 따라서 3D 그래픽엔 텍스처(Texture)라는 것이 필요하다. 텍스처, 즉 질감은 물체의 색상을 표현할 때도 사용된다. 예를 들어, 가상의 사람을 표현한 캐릭터에 텍스처로 피부색이나 캐릭터의 의상 색상 등을 표현하는 식이다.

가상현실(VR) 정의와 구현 방법

어느 정도 3D 개념에 대해 정리했으니 이번에는 가상현실(Virtual Reality, 이하 VR)에 대해 살펴본다. VR 은 컴퓨터로 만든 가상의 세계에서 사람이 실제와 같은 체험을 할 수 있도록 하는 최첨단 기술을 말한다. VR 이 적용된 게임의 경우, 입체적으로 구성된 화면 속에 게이머가 주인공으로 등장해 문제를 풀어나간다. 이러한 가상현실은 의학 분야에서 수술 및 해부 연습에 사용되고 있으며, 항공 · 군사 분야에서 비행 조종 훈련에 이용되는 등 각 분야에서 도입되어 활발히 응용되는 기술이다.

가상현실은 앞서 언급한 3D 기술에 HMD(Head Mounted Display)로 불리는 머리에 착용하는 디스플레이 기기에 의해 구현이 된다. 통신사의 광고나 VR 관련하여 한번쯤은 접해 봤을 것이다.

최근에는 페이스북 CEO인 마크 저커버그가 사명을 메타(Meta)로 바꾸기도 했다. 페이스북은 실제로 HMD의 일 종인 오큘러스 퀘스트 2라는 VR기기를 출시하며 VR의 대중화를 이끌고 있는 회사다. 페이스북의 VR 사례를 통 해 알 수 있듯이 사용자는 이 HMD 기기로 입체적인 3D 환경을 경험할 수 있다.

간단히 그 원리를 설명하자면 HMD는 사람의 오른쪽 눈과 왼쪽 눈의 실제 시각 차이를 구현한 것이다. 두 눈 을 뜬 상태에서 한쪽 눈을 번갈아 감았다 떴다 해보면 앞에 보이는 물체의 위치가 조금씩 바뀌는 걸 알 수 있 다. 이는 각각의 눈의 위치가 다르기 때문에 나오는 현상이다. 사람은 이 양쪽 눈의 시각 차이에서 오는 정보 를 이용해 입체적인 시각 정보를 만들어낸다. 1990 년대에 유행했던 일명 ‘매직아이’, 입체화 영상 그림(오토스테레오그램, Autostereogram)을 아는 이들이라면 이해가 빠를 것이다. HMD 의 왼쪽, 오른쪽 디스플레이에 보이는 화면은 우리가 실제 왼쪽, 오른쪽 눈으로 보는 시각 차이와 비슷하게 보이도록 되어 있다. 또한, 90 년대에 입체 영상 관람 시 각각 다른 색의 셀로판지로 만든 안경을 착용하고 입체 영상을 봤던 경험을 한 이들도 있을 것이다. 이후 나온 3D TV 도 안경을 착용하고 입체 영상을 볼 수 있다. 이러한 기술은 현재 HMD 형태로 발전되어 좀 더 실감나는 입체 환경을 경험할 수 있게 됐다. 그리고 이러한 기술의 발전은 앞으로도 계속될 것이다. 멀지 않은 미래에는 안경 대신 착용하는 렌즈의 형태로도 발전될 수도 있겠다. 물론, 이러한 입체적 시각화 기술로만 메타버스를 구현하는 것은 아니다. 1990 년대 글쓴이가 대학생일 때 처음 경험했던 3D 와 지금의 3D 기술은 많은 차이가 있다. 앞으로도 그 발전 속도는 더 빨라질 것이다. 지금 이 순간에도 많은 IT 기업들이 메타버스 플랫폼, 또는 콘텐츠를 만들기 위해 노력하고 있다.

메타버스 구현을 위한 엔진

원격 전문기업인 알서포트는 현재 3D 게임 엔진을 이용해 메타버스 플랫폼을 개발하고 있다. 대표적인 게임 엔진으로 유니티(Unity)와 언리얼(Unreal)을 꼽을 수 있다. 두 엔진 모두 3D 및 물리(Physics) 엔진을 구현할 수 있도록 다양한 기능을 제공하고 있다.

1. 유니티(Unity) 게임 엔진

2.언리얼(Unreal) 게임 엔진

3.알서포트의 메타버스 구현 엔진

메타버스 구현 환경

마지막으로 고려해야 하는 사항은 바로 구현 환경이다. 유니티 엔진이 장착된 메타버스 플랫폼을 어떤 환경에서 구현할지를 고민해야 한다. 알서포트는 WebRTC(Web Real-Time Communication)에서 메타버스 플랫폼을 구현하기로 했다

이하 중략

현재 세계적인 IT 트렌드와 실제 운영 사례를 봐도 알 수 있듯이 사용자들의 접근성과 사용성이 고려된 WebRTC 환경에서 플랫폼•서비스 구축은 필수적 요소로 자리매김했다. 이러한 이유로 알서포트는 WebRTC 환경에서 메타버스 플랫폼을 구축하기로 했다. 게다가 과거와 달리 현재의 웹 기술과 최신 브라우저로 뛰어난 퍼포먼스의 콘텐츠 개발이 가능하다. 자바스크립트의 실시간 컴파일러 기술과 새로운 API 의 대대적인 퍼포먼스 개선 덕이다. 알서포트가 개발 중인 메타버스 플랫폼 서비스를 한 마디로 요약하면 원격 근무의 몰입도와 연결성 향상에 초점을 둔 ‘가상 오피스’ 서비스이다. 현재 서비스 개발 중인 관계로, 적용 기술에 대해 상세하게 기술할 수는 없으나 앞서 언급한 메타버스 관련 기술과 유니티 게임 엔진에서 WebGL(OpenGL ES 2.0)을 기반으로 개발하고 있다.

알서포트는 메타버스 플랫폼 서비스 ‘가상 오피스’를 통해 웹 환경에서 새로운 사용자 경험을 제공한다는 목표다. 단순히 웹 환경에서 메타버스 플랫폼을 구현하는 것이 아니라 그 안에서 그래픽 데이터의 최적화, 네트워크 패킷 데이터의 최적화 등 웹 환경의 리소스를 최대한 활용하여 최상의 사용자 경험을 제공할 것이다.

자세한 내용은 기술문서 원본에서 확인하실 수 있습니다.

👉 기술문서 원본은 비밀댓글로 요청 (이메일 주소를 남겨주세요)

Tech Inside 5호,

알서포트 XR개발팀 주현삼 팀장님의

'메타버스의 정의와 구현 방법' 의

기술문서를 공개했습니다.

그럼 다음 호로 다시 돌아오겠습니다.

감사합니다.😉

'Tech Inside' 카테고리의 다른 글

| [Tech Inside 7호] 블록체인 기술을 활용한 데이터 보호 (0) | 2022.11.24 |

|---|---|

| [Tech Inside 6호]인공지능(AI)이 할 수 있는 것vs할 수 없는 것 (0) | 2022.10.18 |

| [알서포트 Tech Inside4호] “초거대 인공지능 기술 동향 및 개발 경쟁" 2부 (0) | 2022.08.26 |

| [알서포트 Tech Inside3호] “초거대 인공지능 기술 동향 및 개발 경쟁" 1부 (0) | 2022.08.17 |

| [Tech Inside2호] “다자간 화상회의에 최적화된 WebRTC 미디어 서버 아키텍처" (0) | 2022.07.01 |

댓글